W Cube Group obserwujemy, że w wielu organizacjach dług technologiczny pełni dziś rolę wygodnej wymówki która pozwala podejmować decyzje przypuszczeń i intuicji a nie na podstawie danych. Powoływanie się na niedoskonałość narzędzi analitycznych i raportowania pozwala na odkładanie ważnych decyzji w nieskończoność, usprawiedliwić brak zmian i utrzymać status quo. Jednocześnie coraz wyraźniej widać, że to nie systemy blokują rozwój, lecz brak spójnego podejścia do danych.

Mamy dość danych

Wśród naszych Klientów często widzimy, że największym wyzwaniem nie jest brak narzędzi, ale fakt, że każdy dział operuje na innej definicji sukcesu.

Zobacz również

- marketing raportuje ROAS według własnej metodologii,

- sprzedaż inaczej definiuje przychód,

- finanse zamykają miesiąc według jeszcze innej logiki.

Efekt? Wszyscy mają “rację” ale nikt nie ma pełnego obrazu sytuacji. W takiej sytuacji nie podejmujemy decyzji na podstawie danych lecz pomimo danych.

Definiowanie problemu

Najpierw odpowiedz czy pomimo posiadania całego zestawu danych ciągle trafiasz na ograniczenia które wpływają na:

Czy czeka nas „cyfrowa nieśmiertelność”? Meta będzie mogła publikować za ciebie treści nawet, gdy umrzesz

- tempo podejmowania decyzji,

- trafność alokacji budżetu,

- zdolność do skalowania działań.

Jeżeli przygotowanie jednego raportu trwa kilka dni, a każda analiza wymaga ręcznej pracy w Excelu, organizacja działa w trybie reaktywnym. Kolejny krok to odpowiedź na pytanie które ograniczenia wynikają z przestarzałej technologii a które z braku wiedzy i błędnego zarządzania informacją.

Słuchaj podcastu NowyMarketing

Jak zacząć działać pomimo ograniczeń technologicznych

Moment przejścia między zdefiniowaniem problemu a realnym działaniem nie zaczyna się od wdrożenia nowych narzędzi, lecz od zmiany sposobu myślenia. Organizacje zbyt często koncentrują się na tym, czego im brakuje, zamiast wykorzystać to, co już posiadają. To podejście widzimy regularnie w projektach realizowanych w Cube Group, tymczasem nawet przy niedoskonałej technologii możliwe jest uporządkowanie podstaw, ustalenie wspólnych definicji kluczowych metryk i ograniczenie chaosu informacyjnego w najbardziej krytycznych obszarach. To właśnie ten pierwszy krok pozwala wyjść z trybu ciągłego oczekiwania na „lepszy system” i zacząć podejmować decyzje w oparciu o dostępne dane.

W praktyce oznacza to przesunięcie uwagi z problemów technologicznych na problemy decyzyjne. Jeśli organizacja nie jest w stanie szybko odpowiedzieć na podstawowe pytania biznesowe, to najczęściej nie wynika to z braku narzędzi, lecz z braku spójności w interpretacji danych. Dlatego zamiast inwestować w kolejne integracje, warto najpierw uporządkować logikę i zdefiniować co dokładnie oznaczają kluczowe wskaźniki.

Single Source of Truth: jedna logika zamiast wielu interpretacji

To naturalnie prowadzi do koncepcji Single Source of Truth, która nie jest rozwiązaniem technologicznym, lecz decyzją organizacyjną. Nie chodzi o jedno narzędzie, ale o jedną wersję prawdy czyli spójny i zrozumiały sposób segmentacji, agregacji i interpretowania danych, niezależnie od źródła. Na takim fundamencie technologia zaczyna realnie wspierać biznes, zamiast go komplikować.

Większość firm produkuje raporty, ale niewiele buduje narzędzia, które faktycznie przyspieszają działanie. Raport pokazuje tylko wąski, wyrwany z kontekstu zakres danych, często zwiększa chaos informacyjny przez dostarczanie niepotrzebnych informacji. Kokpit działa inaczej, koncentruje się na kilku kluczowych wskaźnikach, pokazuje zmianę w kontekście i umożliwia szybkie przejście od informacji do decyzji. Z perspektywy zarządu nie jest to zmiana wizualna, lecz operacyjna.

Jak zbudować Single Source of Truth na tym, co już masz

W większości przypadków organizacja posiada już niemal wszystko co jest potrzebne do budowy kokpitu, dane reklamowe i finansowe są dostępne, budżety i cele zdefiniowane, a brakującym elementem jest ich logiczne połączenie. W Cube doskonale wiemy że Single Source of Truth można zbudować w oparciu o powszechnie używane narzędzia analityczne i prostą warstwę transformacji danych opartą na SQL.

Kluczowa zmiana polega na przejściu z poziomu raportowania w narzędziach na poziom pracy na danych źródłowych. Zamiast polegać wyłącznie na gotowych widokach w systemach takich jak Google Analytics 4 czy platformach reklamowych, dane są eksportowane do wspólnego środowiska (np. Google BigQuery), gdzie można je łączyć, oczyszczać i standaryzować. To właśnie SQL staje się tutaj językiem budowania wspólnej logiki, definicji przychodu, kosztu czy użytkownika.

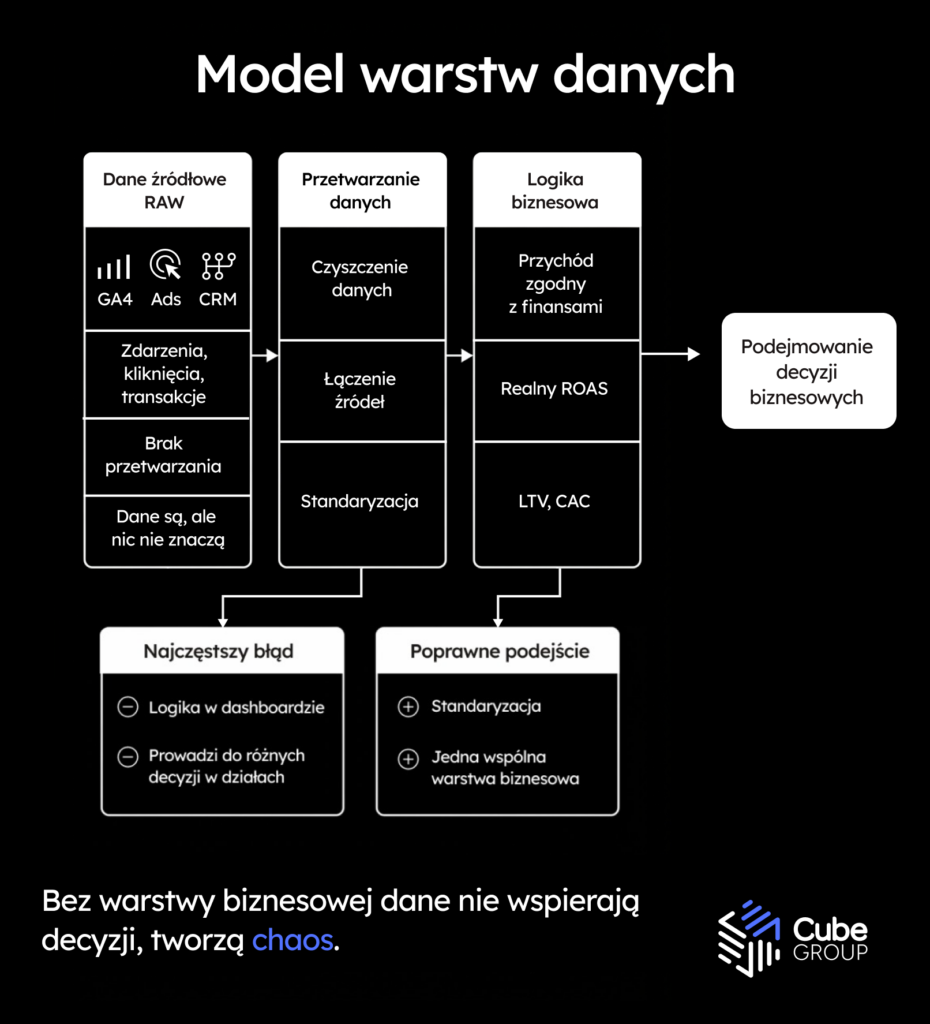

W praktyce oznacza to tworzenie prostych warstw danych: najpierw surowych tabel z różnych źródeł, następnie warstwy przetworzonej, w której dane są ujednolicone, i wreszcie warstwy biznesowej, która zawiera gotowe do użycia metryki. Nawet relatywnie proste zapytania SQL pozwalają wyeliminować niespójności, które wcześniej blokowały decyzje.

Dzięki temu Single Source of Truth przestaje być koncepcją zarezerwowaną dla dużych projektów technologicznych. Staje się praktycznym podejściem, które można wdrożyć szybko, iteracyjnie i bez zmiany całego stacku – wykorzystując to, co organizacja już posiada.

Przykładowe wdrożenie w Google Cloud (BigQuery)

W praktyce wdrożenie nie zaczyna się od skomplikowanej architektury, ale od zebrania kluczowych danych w jednym miejscu. BigQuery pełni tu rolę centralnej warstwy analitycznej, do której trafiają najważniejsze informacje z różnych systemów.

- Start od BigQuery: Kluczowe dane trafiają do jednego projektu w Google BigQuery jako centralnej warstwy analitycznej

- Łatwe źródła: Integracja danych z Google Analytics 4, Google Ads i Google Search Console jest szybka i natywna

- Dodatkowe kanały: Dane z platform takich jak Meta Ads czy TikTok Ads importowane są przez konektory (np. Supermetrics)

- Największe wyzwanie: Eksport danych sprzedażowych z CRM lub e-commerce wymaga więcej pracy, ale dla doświadczonego zespołu jest to proces standardowy, nie technologiczna bariera

Kompetencje, które spajają dane w całość

Samo zebranie danych w jednym miejscu nie wystarczy. Kluczowa jest wiedza, która pozwala nadać im sens i przełożyć je na decyzje biznesowe. W praktyce oznacza to połączenie kilku kompetencji: analitycznych, technicznych i programistycznych.

- Analityka biznesowa: Zrozumienie, które metryki mają realne znaczenie (np. przychód, LTV, CAC) i jak powinny być liczone w kontekście konkretnego modelu biznesowego

- Doświadczenie analityczne: Umiejętność łączenia danych z różnych źródeł w sposób, który odzwierciedla rzeczywistość, a nie tylko strukturę systemów

- Audyt danych: Weryfikacja poprawności zbierania danych w narzędziach takich jak Google Analytics 4, identyfikacja braków i niespójności

- SQL i transformacje: Zdolność do pracy na danych źródłowych i budowania warstwy logiki w Google BigQuery, która łączy wszystko w spójny model

Integracja danych: od użytkownika do przychodu

Kolejnym krokiem jest połączenie danych w spójny model, który pozwala przejść od pojedynczych zdarzeń do pełnego obrazu klienta i jego wartości.

- Źródło prawdy: Fundament stanowią dane sprzedażowe i użytkownikowe z CRM lub platformy e-commerce

- Warstwa analityczna: Do tych danych dopasowujemy zdarzenia i identyfikatory z Google Analytics 4

- Kontekst marketingowy: Całość uzupełniamy o dane kampanijne z systemów reklamowych

- Łączenie danych: Dzięki identyfikatorom (user_pseudo_id, ID transakcji, ID klienta, email, NIP) budujemy spójny obraz użytkownika

Nowe możliwości analityczne

Po zintegrowaniu danych pojawia się realna wartość, możliwość analizy biznesu na poziomie, który wcześniej był niedostępny przy rozproszonych źródłach.

- Realny LTV: Połączenie danych pozwala analizować rzeczywistą wartość klienta, a nie estymacje narzędzi marketingowych

- Prawdziwy przychód: Raportowanie oparte na CRM daje pełną zgodność z finansami

- Kontrola jakości: Na bieżąco monitorujemy różnice między GA4 a rzeczywistym przychodem

- Krok dalej: Uzyskujemy fundament do analizy marży, nie tylko przychodu

Pełna kontrola nad danymi i atrybucją

Dostęp do surowych danych zmienia sposób pracy z ograniczonego raportowania przechodzimy do pełnej kontroli nad analizą.

- Odzyskany ruch: Surowe dane pozwalają identyfikować „zagubiony ruch” (np. z Meta), niewidoczny w GA4

- Brak ograniczeń: Nie jesteśmy uzależnieni od domyślnej atrybucji GA4

- Własne modele: Możemy budować własne raporty ścieżek konwersji

- Zaawansowana analityka: Kolejny krok to tworzenie własnych modeli atrybucji dopasowanych do biznesu

Wizualizacja: od danych do decyzji

Warstwa wizualizacji jest momentem, w którym cała praca z danymi zaczyna przynosić realną wartość biznesową. To tutaj transformacje danych przekładane są na czytelne, operacyjne wskaźniki dostępne dla całej organizacji. Również w tym przypadku możemy polegać na powszechnie dostępnych, tanich lub darmowych narzędziach.

- Looker Studio: Darmowe narzędzie Looker Studio pozwala szybko budować kokpity bez dodatkowych kosztów licencyjnych

- Bezpośrednie połączenie: Integracja z Google BigQuery zapewnia dostęp do aktualnych, przetworzonych danych

Za ich pomocą bez problemu możemy zamknąć projekt w sposób który zapewni nam:

- Kokpity decyzyjne: Zamiast rozbudowanych raportów tworzone są widoki oparte na kilku kluczowych KPI

- Jedna wersja prawdy: Każdy użytkownik pracuje na tych samych danych i definicjach

- Dostępność: Dane są dostępne w czasie rzeczywistym dla zespołów i zarządu

Dobrze zaprojektowana wizualizacja nie polega na prezentacji danych, ale na prowadzeniu do decyzji.

Efekt: dane, które prowadzą do decyzji

Efektem takiego podejścia nie jest tylko lepsze raportowanie, ale realna zmiana w sposobie podejmowania decyzji w organizacji.

- Szybkość decyzji: Dane są dostępne w jednym miejscu, bez ręcznego łączenia

- Precyzja działań: Marketing operuje na rzeczywistych wynikach, nie przybliżeniach

- Spójny obraz: Każdy dział widzi te same liczby i tę samą logikę

- Realna przewaga: Dane przestają być raportem, stają się systemem podejmowania decyzji

Przykładowe decyzje których podjęcie byłoby niezwykle trudno bez kokpitu analitycznego:

Poprawa wyniku finansowego dzięki obniżeniu sprzedaży. W jednym z realizowanych przez nas projektów kampanie wyglądały na rentowne w panelach reklamowych, ale wynik finansowy się nie spinał. Po wdrożeniu Single Source of Truth i połączeniu danych z systemu sprzedażowego z danymi marketingowymi okazało się, że część kampanii generowała sprzedaż o niskiej marży, często opartą na intensywnych rabatach. Z poziomu platform reklamowych wyglądało to dobrze, ale po uwzględnieniu realnych kosztów biznes tracił. Dopiero dostęp do pełnych danych pozwolił przesunąć budżet w stronę produktów i kampanii o wyższej rentowności, co w krótkim czasie przełożyło się na poprawę wyniku finansowego, mimo niższych wolumenów sprzedaży i spadkom ROAS.

Wstrzymanie TOP kampanii przed wyczerpaniem się oferty. Najpopularniejsze oferty wynajmu długoterminowego generowały bardzo duży wolumen leadów sprzedażowych których w ostatecznym rozrachunku nie dało się obsłużyć przez niewystarczającą liczbę aut. Problemu nie mogło rozwiązać wstrzymywanie kampanii w momencie wyczerpania się oferty ponieważ okres od kontaktu do finalizacji potrafi trwać nawet ponad 3 tygodnie.

Po połączeniu danych marketingowych z CRM możliwe było określenie realnego wskaźnika konwersji leadów na podpisane umowy dla konkretnych modeli i ofert. Na tej podstawie zespół był w stanie estymować, ile zapytań wystarczy do „zamknięcia” dostępnej puli pojazdów. Kampanie były wstrzymywane jeszcze przed faktycznym wyczerpaniem floty, w momencie, gdy liczba pozyskanych leadów gwarantowała sprzedaż. Dzięki temu firma przestała przepalać budżet na pozyskiwanie klientów, których i tak nie była w stanie obsłużyć.

Najczęstsze błędy

Najczęstszym błędem na tym etapie jest próba naprawy wszystkiego jednocześnie. Integracja wszystkich systemów, budowa pełnej hurtowni danych i projektowanie wielu dashboardów równolegle prowadzi do długich, kosztownych inicjatyw, które przez miesiące nie dostarczają realnej wartości. Znacznie skuteczniejsze podejście opiera się na zawężeniu zakresu: rozpoczęciu od jednego obszaru decyzyjnego, zdefiniowaniu kluczowych KPI, zbudowaniu jednego kokpitu dla zarządu i iteracyjnym rozszerzaniu rozwiązania.

Równie częstym problemem jest skupienie się na narzędziach zamiast na logice danych. Organizacje inwestują w kolejne systemy i integracje, zakładając, że technologia rozwiąże problem niespójności. W praktyce bez wspólnych definicji metryk i jasnych zasad interpretacji danych nawet najlepszy stack tylko przyspiesza chaos, zamiast go eliminować.

Trzeci błąd to budowanie raportów zamiast systemu decyzyjnego. Dane są prezentowane w formie rozbudowanych dashboardów, które odpowiadają na pytanie „co się wydarzyło”, ale nie prowadzą do działania. Brakuje kontekstu, priorytetyzacji i powiązania z realnymi decyzjami biznesowymi, przez co analityka staje się kosztem, a nie dźwignią wzrostu.

Najczęstsze obawy: kompetencje i koszty

Wiele organizacji zakłada, że wdrożenie takiego podejścia wymaga budowy wewnętrznego zespołu z kompetencjami analitycznymi, technicznymi i biznesowymi. W praktyce nie jest to konieczne. Kompetencje takie jak SQL, wizualizacja danych czy data storytelling mogą być skutecznie outsourcowane, szczególnie na etapie budowy fundamentów. Pozwala to znacząco skrócić czas wdrożenia i uniknąć kosztownych błędów wynikających z braku doświadczenia.

Drugą obawą są koszty infrastruktury. W przypadku projektu opartego o Google BigQuery dla sklepu generującego około 10 milionów zdarzeń miesięcznie, koszty przetwarzania i przechowywania danych są relatywnie niskie i przewidywalne, zazwyczaj mieszczą się w przedziale od kilkudziesięciu do kilkuset dolarów miesięcznie, w zależności od sposobu zapytań i optymalizacji. Kluczowe jest jednak strategiczne podejście do danych.

Nie wszystkie dane muszą być zbierane i przechowywane w nieskończoność. W wielu przypadkach ograniczenie zakresu zbieranych informacji do tych, które realnie wspierają decyzje biznesowe, pozwala nie tylko obniżyć koszty, ale również uprościć cały model analityczny. Paradoksalnie mniej danych, ale lepiej zdefiniowanych, daje większą wartość niż rozbudowane, ale nieużywane zbiory.

Podsumowując

Dług technologiczny bardzo rzadko jest prawdziwym stoperem. Znacznie częściej jest wygodnym uzasadnieniem braku decyzji. Organizacje nie przegrywają dlatego, że nie mają narzędzi, przegrywają dlatego, że nie mają wspólnej logiki danych. W efekcie zamiast podejmować decyzje szybciej i trafniej, grzęzną w dyskusjach o liczbach, które dla każdego znaczą coś innego. To nie technologia spowalnia biznes, tylko brak spójności w jej wykorzystaniu.

Single Source of Truth zmienia ten układ. Nie przez kolejne wdrożenie, ale przez uproszczenie, jedną definicję, jeden model, jeden punkt odniesienia. Na tym fundamencie nawet proste narzędzia zaczynają działać jak dźwignia. Dane przestają być raportem do analizy po fakcie, a stają się systemem operacyjnym, który prowadzi do decyzji tu i teraz. Kluczowe jest jednak rozpoczęcie działania, otwarta rozmowa wewnątrz organizacji o tym, jak naprawdę rozumiemy dane, oraz gotowość do sięgnięcia po wsparcie z zewnątrz tam, gdzie brakuje kompetencji. Transformacja nie wymaga rewolucji, wystarczy jeden dobrze zdefiniowany obszar analizy, prosty kokpit i konskfętnie stawiane małe kroki, które stopniowo budują przewagę.