NASK opublikował raport, który pokazuje reakcje platform społecznościowych na zgłoszenia treści w 2025 roku. Opracowanie analizuje, jak skuteczne są mechanizmy moderacyjne platform, wskazuje wyzwania we współpracy z nimi oraz przedstawia dane dotyczące m.in. dezinformacji wyborczej, zdrowotnej i operacji wpływu z wykorzystaniem technologii.

Wśród głównych wniosków pojawiają się informacje na temat tego, że usuwanie fałszywych informacji wciąż bywa nieskuteczne, a część zgłoszonych materiałów wciąż pozostaje dostępna w sieci.

Pełna wersja raportu znajduje się na stronie.

Co obejmuje raport

Opracowanie uwzględnia zarówno zgłoszenia wewnętrzne, pochodzące z 7-dniowego monitoringu mediów i mediów społecznościowych prowadzonego przez Ośrodek Analizy Dezinformacji, jak i zgłoszenia zewnętrzne przekazywane przez obywateli, instytucje oraz służby publiczne.

Każdy incydent został zaklasyfikowany do jednej z trzech kategorii:

- podszywanie się pod osoby publiczne lub instytucje,

- fałszywe informacje,

- treści manipulacyjne (w tym deepfake oraz skoordynowane operacje wpływu).

Znacząca część zgłoszeń dotyczyła treści mogących oddziaływać na proces wyborczy. Raport obejmuje również dezinformację zdrowotną, kampanie reklamowe wyłudzające dane i środki finansowe, masowe generowanie zmanipulowanych treści z wykorzystaniem AI oraz operacje wykorzystujące wizerunki osób publicznych.

Poza analizą ilościową raport dokumentuje także uwarunkowania operacyjne współpracy z platformami społecznościowymi, w tym:

- brak przejrzystych procedur zgłaszania treści,

- niesprecyzowany czas reakcji,

- niejednolite stosowanie regulaminów,

- ograniczoną transparentność decyzji moderacyjnych.

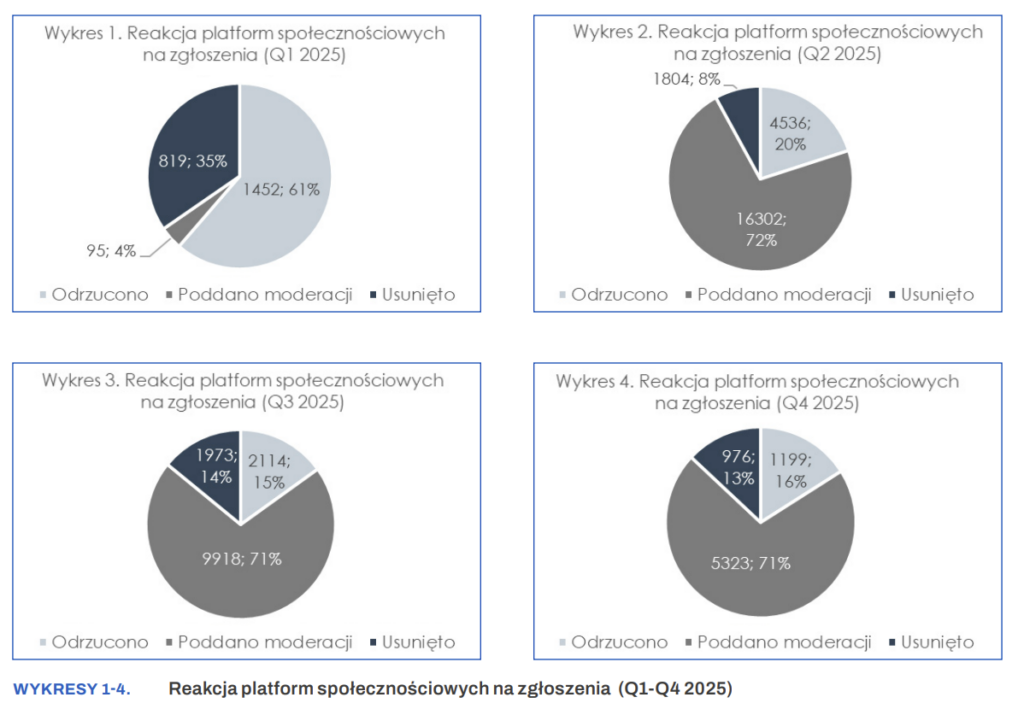

Skala zgłoszeń i struktura reakcji

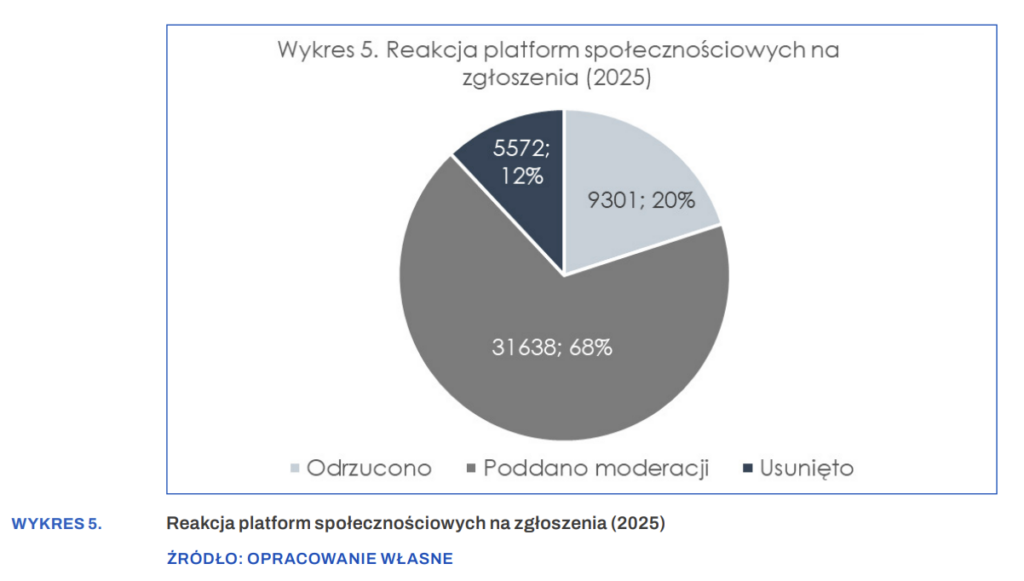

Spośród 46 511 zgłoszonych materiałów:

- 12 proc. zostało usuniętych,

- 68 proc. poddano moderacji,

- 20 proc. pozostało bez reakcji platform.

Oznacza to, że 9 301 treści dezinformacyjnych nadal funkcjonuje w sieci.

Dane pokazują, że platformy częściej stosowały moderację treści niż ich trwałe usuwanie. Oznacza to, że odpowiedzialność przesuwa się z eliminowania treści na ograniczanie ich zasięgu lub działania kont.

Brak transparentności platform w usuwaniu szkodliwych i zmanipulowanych przekazów prowadzi do tego, że 20 procent nadal oddziałuje na odbiorców. A to tylko liczba materiałów z zeszłego roku. Problemem nie jest tylko pojawianie się dezinformacji. Zagrożeniem jest brak transparentności ze strony platform w zakresie działania algorytmów, które zamykają nas często na wybiórcze, szkodliwe i zmanipulowane treści.

źródło: gov.pl, opracowanie: Agata Drynko