Przypomnieć należy, że przepisy DSA obowiązywały od końca sierpnia 2023 r. – w stosunku do wybranych platform o liczbie użytkowników w UE większej niż 45 mln (10% ludności UE). Oznacza to, że chodziło bardzo duże platformy internetowe (VLOPs) i bardzo duże wyszukiwarki internetowe (VLOSs).

Zakres podmiotowy i rodzaje usług

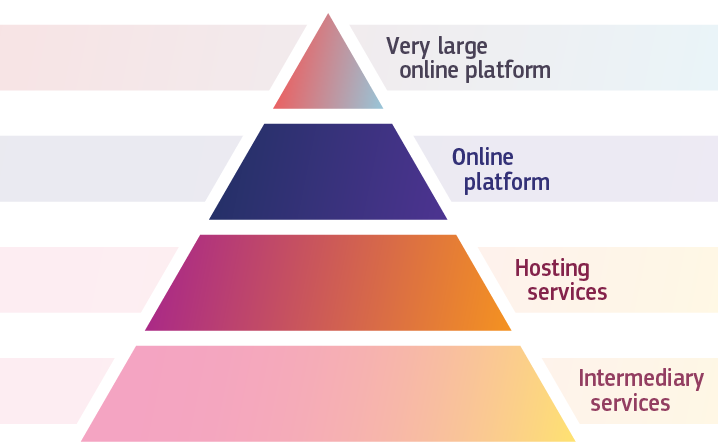

DSA obowiązuje zasadniczo 4 kategorie podmiotów:

Zobacz również

fot. comission.europa.eu

Poza VLOPs i VLOSs, akt o usługach cyfrowych obejmuje: usługi pośrednictwa (dostawcy internetu, rejestracja domen, hosting – czyli podmioty oferujące szeroko rozumianą infrastrukturę sieciową), platformy internetowe (platformy handlowe, sklepy z aplikacjami, społecznościowe platformy współpracy i platformy serwisów społecznościowych), czy usługi hostingowe (hosting w chmurze i hosting stron internetowych).

Nowe/stare obowiązki (?)

Akt o usługach cyfrowych rozpoczyna się od definicji hostingu, opisując go jako proces przetwarzania informacji przekazanych przez użytkownika oraz na jego żądanie. Na mocy tego dokumentu, firmy hostingowe, działające w chmurze, zostaną zobowiązane do stosowania tych regulacji. W praktyce oznacza to, że muszą dostosować swoje regulaminy usług tak, żeby uwzględniały wszystkie aspekty wskazane przez DSA.

UODO: kara dla Glovo za gromadzenie skanów i zdjęć dowodów tożsamości użytkowników aplikacji

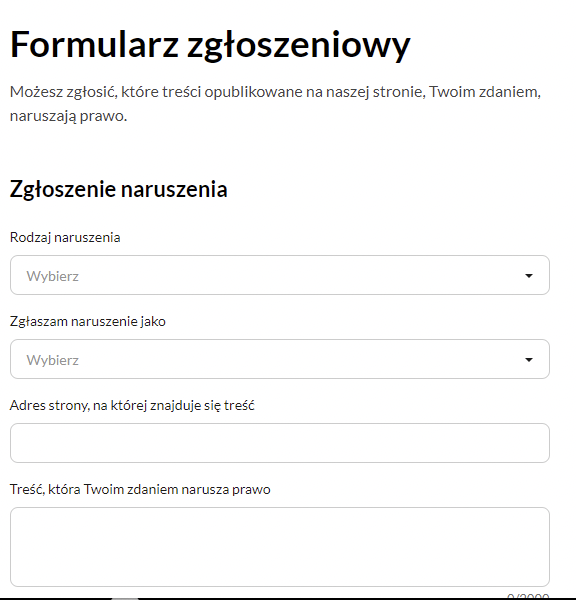

Jednym z kluczowych elementów nowych przepisów jest wprowadzenie mechanizmów umożliwiających zgłaszanie nielegalnych treści (ang. notice & take action). Dlatego każdy dostawca usług hostingowych powinien udostępnić na swojej stronie internetowej odpowiedni formularz do składania takich zgłoszeń.

Słuchaj podcastu NowyMarketing

Bardzo ważnym elementem jest tu przeniesienie procedury, dotychczas regulowanej przez artykuł 14. ustawy o świadczeniu usług drogą elektroniczną, do nowego aktu prawnego. Procedura ta dotyczy działań podmiotu hostingowego w przypadku otrzymania oficjalnego zawiadomienia lub wiarygodnej wiadomości o bezprawnym charakterze przechowywanych danych na stronach internetowych.

To przeniesienie wprowadza istotne zmiany w obowiązkach hostingodawcy w sytuacjach, gdy otrzyma on uzasadnione informacje o potencjalnych naruszeniach prawa. Regulacje dotyczące usług hostingowych stanowią podstawę również dla przepisów dotyczących platform internetowych, które są ich szczególną podkategorią. Platforma internetowa, będąc usługą hostingu, przechowuje i udostępnia informacje na żądanie użytkownika. Należy tutaj zwrócić uwagę na kwestie związane z wiarygodnością informacji pochodzących np. z zagranicznych sklepów internetowych oraz na konieczność podjęcia decyzji przez hostingodawcę – czy zgodnie z nowym rozporządzeniem może on usunąć treści z danego serwisu internetowego, któremu udostępnia swoją usługę.

W przypadku, gdy informacje przekazane przez odbiorców stanowią nielegalne treści lub są niezgodne z warunkami korzystania z usług, dostawca będący platformą internetową (podkategoria hostingodawców) dostawca może podjąć decyzje:

- w sprawie usunięcia informacji, uniemożliwienia do nich dostępu lub ograniczenia widoczności informacji;

- w sprawie zawieszenia lub zakończenia świadczenia usługi, w pełni lub częściowo, na rzecz odbiorców;

- w sprawie zawieszenia lub zamknięcia kont odbiorców;

- w sprawie zawieszenia, zakończenia lub ograniczenia w inny sposób możliwości monetyzacji informacji przekazanych przez odbiorców.

Jeżeli dostawca podejmuje takie decyzje, musi zapewnić odbiorcom usługi, w tym osobom lub podmiotom, które dokonały zgłoszenia – przez okres co najmniej sześciu miesięcy od podjęcia decyzji, skuteczny wewnętrzny system rozpatrywania skarg. System tem ma umożliwić zainteresowanym elektroniczne i bezpłatne wnoszenie skarg na decyzję podjętą przez dostawcę platformy internetowej po otrzymaniu zgłoszenia.

Obowiązki informacyjne

Dostawcy usług pośrednich muszą pamiętać także o obowiązkach informacyjnych. Wyznaczają pojedynczy punkt kontaktowy umożliwiający im bezpośrednią komunikację drogą elektroniczną z organami publicznymi, a także udostępniają publicznie informacje niezbędne do łatwego zidentyfikowania ich pojedynczych punktów kontaktowych i kontaktowania się z nimi. Informacje te muszą być ogólnodostępne i aktualizowane na bieżąco, co może nastąpić m.in. poprzez publikację informacji na stronie internetowej danego podmiotu.

W powyższych informacjach dostawcy usług pośrednich określają język lub języki urzędowe państw członkowskich, które, oprócz języka szeroko rozumianego przez jak największą liczbę obywateli Unii Europejskiej, można wykorzystywać do celów komunikacji z ich punktami kontaktowymi. Jednocześnie, języki te muszą obejmować co najmniej jeden z języków urzędowych państwa członkowskiego, w którym dostawca usług pośrednich ma swoje główne miejsce prowadzenia działalności lub w którym jego przedstawiciel prawny ma miejsce zamieszkania lub siedzibę.

Dostawcy usług wyznaczają także pojedynczy punkt kontaktowy umożliwiający odbiorcom usługi bezpośrednią i szybką komunikację drogą elektroniczną, w tym poprzez umożliwienie odbiorcom usługi wyboru środków komunikacji, które nie mogą opierać się wyłącznie na zautomatyzowanych narzędziach. Z kolei Ci z dostawców, którzy nie mają siedziby w Unii, ale oferują usługina tym terenie, wyznaczają na piśmie osobę prawną lub fizyczną do działania w charakterze ich przedstawiciela prawnego w jednym z państw członkowskich, w których dostawca oferuje swoje usługi.

Zwodnicze interfejsy (ang. dark patterns)

Jednym z głównych celów aktu o usługach cyfrowych jest przeciwdziałanie dezinformacji i wprowadzaniu w błąd, w tym stosowaniu tzw. „zwodniczych interfejsów” (ang. „dark patterns”) – szczególnie tych związanych z opisami produktów czy informacjami o towarach, które mogą wpłynąć na decyzje zakupowe. Choć niektóre z tych praktyk były nielegalne już wcześniej, nowe przepisy ukierunkowane są na jeszcze bardziej skuteczne zwalczanie nieetycznych działań.

Dostawcy platform internetowych nie mogą bowiem projektować, organizować ani obsługiwać swoich interfejsów internetowych w sposób, który wprowadza w błąd odbiorców usługi, manipuluje nimi lub w inny istotny sposób zakłóca albo ogranicza zdolność do podejmowania wolnych i świadomych decyzji.

W świetle DSA operatorzy platform będą musieli podjąć tzw. „działania moderacyjne” w przypadku uzasadnionych informacji o nielegalnych treściach. W praktyce oznacza to wstrzymywanie publikacji i usuwanie treści naruszających regulamin.

W DSA wprost wskazane są przykłady takich nielegalnych treści, którymi może być m.in.:

- udostępnianie obrazów przedstawiających niegodziwe traktowanie dzieci w celach seksualnych;

- bezprawne udostępnianie prywatnych obrazów bez zgody właściciela;

- cyberstalking;

- sprzedaż produktów niespełniających wymogów lub podrobionych;

- sprzedaż towarów lub świadczenie usług z naruszeniem prawa ochrony konsumentów;

- nieuprawnione wykorzystanie materiałów chronionych prawem autorskim;

- nielegalne oferowanie usług zakwaterowania lub nielegalna sprzedaż żywych zwierząt.

Na akt o usługach cyfrowych powinni zwrócić uwagę głównie ci sprzedawcy, którzy sprzedają w modelu cross-border. Ważne jest zwracanie uwagi na przepisy obowiązujące w państwie dostawy, aby uniknąć ryzyka naruszenia prawa. Nowe przepisy mają na celu przeciwdziałanie praktykom szkodliwym, a ich skutki będą odczuwalne już w najbliższych miesiącach.

Potencjalne naruszenia

Komisja Europejska posiada szerokie uprawnienia na gruncie DSA i zaczęła z nich aktywnie korzystać. Poniżej kilka przykładów, w jakim zakresie niektórzy dostawcy już dzisiaj muszą tłumaczyć się z mechanizmów zaimplementowanych w ich usługach.

TikTok, You Tube, Bing, Google Search, X, Facebook, Snapchat, Instagram

Komisja poprosiła dwie pierwsze platformy o dodatkowe informacje na temat środków, które zostały podjęte w celu wypełnienia obowiązków związanych z ochroną małoletnich na mocy DSA. Chodziło przede wszystkim o kwestie związane z oceną ryzyka i środkami ograniczającymi ryzyko w celu ochrony małoletnich w internecie, w szczególności w odniesieniu do zagrożeń dla zdrowia psychicznego i fizycznego, oraz zapisy dotyczące korzystania z ich usług przez małoletnich.

Operatorzy wszystkich z powyższych narzędzi zostali z kolei poproszeni o dostarczenie informacji na temat stosowanych przez nich środków ograniczających ryzyko związane z generatywną sztuczną inteligencją, takich jak tzw. halucynacje. Chodzi o sytuację, w których sztuczna inteligencja dostarcza fałszywych informacji, a także o wirusowe rozpowszechnianie deepfake’ów oraz zautomatyzowaną manipulację usługami, które mogą wprowadzać wyborców w błąd.

Generatywna sztuczna inteligencja jest bowiem jednym z zagrożeń zidentyfikowanych przez Komisję w projekcie wytycznych dotyczących integralności procesów wyborczych. Ich celem jest zapewnienie VLOP i VLOSE najlepszych praktyk i przykładów potencjalnych środków łagodzących ryzyko związane z wyborami, w tym konkretnych środków związanych z generatywną sztuczną inteligencją.

Apple, Google, Amazon i AliExpress

Weryfikacją w przypadku Apple i Google jest to, w jak staranny sposób wskazani dostawcy zidentyfikowali wszelkie ryzyka systemowe dotyczące App Store i Google Play. Komisja domaga się również od App Store i Google Play więcej informacji na temat ich zgodności z przepisami mającymi zastosowanie do internetowych platform handlowych oraz przejrzystości związanej z systemami rekomendacji i reklamami online.

Weryfikacja w Amazon i AliExpress dotyczy również środków łagodzących, jakie wdrożono w celu ochrony konsumentów online, w szczególności w odniesieniu do rozpowszechniania nielegalnych produktów, takich jak podrobione leki.

Te postępowania wyjaśniające mogą zakończyć się rozpoczęciem formalnych postępowań, jeżeli Komisja Europejska uzna, że nie otrzymała staysfakcjonujących odpowiedzi, a musimy pamiętać, że sankcje, które mogą dotknąć przedsiębiorców, są dość dotkliwe.

Począwszy od 17 lutego 2024 r. Komisja może nakładać grzywny w wysokości do 6% światowego rocznego obrotu w przypadku naruszenia obowiązków wynikających z DSA, nieprzestrzegania środków tymczasowych czy naruszenia zobowiązań. Ponadto mogą być nakładane kary okresowe w wysokości do 5% średniego dziennego światowego obrotu za każdy dzień opóźnienia w zastosowaniu się do środków zaradczych, środków tymczasowych, zobowiązań (w następstwie braku zgodności z decyzją kolegium nakładającą środki zaradcze, środki tymczasowe lub podejmującą wiążące zobowiązania). W ostateczności, jeżeli naruszenie utrzymuje się i powoduje poważne szkody dla użytkowników oraz pociąga za sobą przestępstwa zagrażające życiu lub bezpieczeństwu osób, Komisja może zażądać nawet tymczasowego zawieszenia usługi.

Podsumowanie

Zarówno DSA, jak i planowane regulacje, takie jak „AI Act”, kierują branżę e-commerce w stronę nowych wyzwań, nakładając konieczność dostosowania się do rozwiniętych standardów i przepisów. Wprowadzanie tych zmian wymaga od rynków e-commerce zaadaptowanie swoich praktyk do coraz bardziej rygorystycznych norm regulacyjnych.

Przykłady dobrych praktyk wdrożenia DSA:

fot. główne: Freepik

PS Komisja Europejska bierze pod lupę X. Czy platforma Elona Muska tolerowała nielegalne treści?

Komisja Europejska zdecydowała o wszczęciu formalnego postępowania, w którym oceni, czy platforma X (dawniej Twitter) dopuściła się naruszenia przepisów ustawy o usługach cyfrowych (DSA). Chodzi o brak reakcji na pojawiające się na platformie nielegalne treści o charakterze terrorystycznym i manipulacyjnym.

PS2 Polska organizacja SIN oraz Fundacja Panoptykon wygrywają z Facebookiem w sądzie

W 2018 roku Meta naruszyła dobra osobiste organizacji SIN, blokując konta i grupy Społecznej Inicjatywy Narkopolityki. Sąd wydał wyrok w sprawie prowadzonej przez Fundację Panoptykon, potwierdzając tym samym, że platformy internetowe nie mogą blokować jak chcą i kogo chcą, a osoby zablokowane mają prawo do sądu we własnym kraju.